預見2030:人工智慧進入監獄的可能發展

隨著人工智慧(AI)技術快速進展,許多歐美國家正積極評估其在刑事司法與監所管理領域的潛力與風險。本研究聚焦於2030年監獄場域中AI技術的應用趨勢與道德辯論,特別針對其如何改變監獄內部行為監控、風險評估與決策流程進行探討。

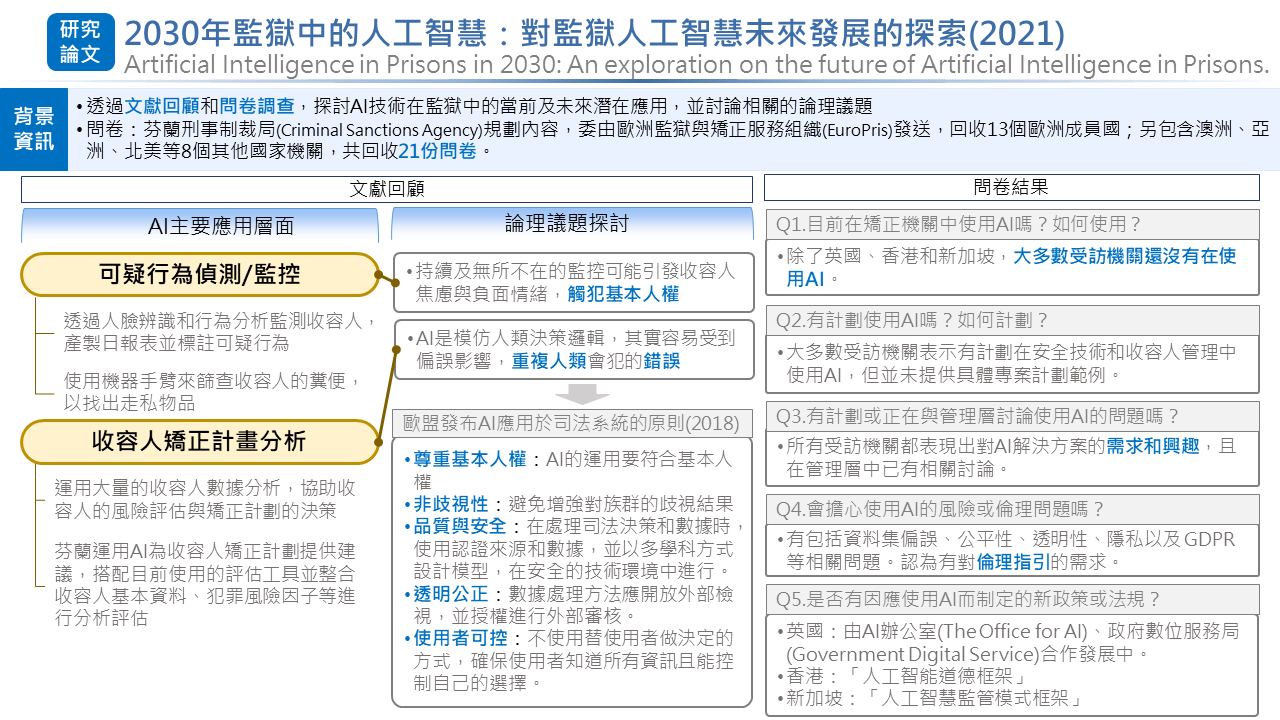

本研究研析芬蘭的研究文章-2030年監獄中的人工智慧:對監獄人工智慧未來發展的探索,透過文獻回顧和問卷調查,探討未來AI技術在監獄領域的可能應用與走向,並透過國際視角進行文獻回顧和全球問卷調查。其中問卷為芬蘭刑事制裁局(Criminal Sanctions Agency)規劃內容,委由歐洲監獄與矯正服務組織(EuroPris)發送,回收13個歐洲成員國;另包含澳洲、亞洲、北美等8個其他國家機關,共回收21份問卷,本文章提供矯正機關或對智慧監獄有興趣者參考。

AI在監獄的主要應用面向

AI技術目前已於歐洲與英國監獄部分試點導入,主要集中於以下兩大應用面:

1. 可疑行為偵測/監控

(1) 利用AI影像辨識技術,分析監視畫面中可能涉及暴力、鬥毆或自傷等異常行為,提升即時反應能力。

(2) AI亦可結合聲音感知或動作模式追蹤技術,判斷囚犯之間的互動是否有潛在衝突風險。

2. 收容人矯正計畫分析

(1) 分析囚犯個人背景、行為模式、再犯機率與復歸社會風險,提供更客觀的評估基礎。

(2) AI可用於判斷適合的教育課程、心理治療介入與職能訓練安排,提升個別化管理效益。

倫理與治理挑戰

儘管AI應用展現潛力,但也伴隨重大倫理與法律問題,引發學界與政策單位關注:

1. 資料正義與偏誤風險

(1) 資料品質與來源將影響AI判斷的公正性與可靠性,若資料含有偏見,AI可能加劇既有的不平等。

2. 監控正當性與人權界線

(1) 持續監控與行為預測技術可能侵犯收容人隱私與自由,引發人權監察組織的疑慮。

(2) 倫理辯論聚焦於:AI是否應具備預測與懲罰的功能?若錯判,應由誰承擔責任?

3. 缺乏跨部門治理機制

(1) 歐洲國家多數尚未建立針對AI於監獄應用的治理框架,現有多仰賴資料保護規範(如GDPR)作為防線。

(2) 僅有少數單位(如英國The Office for AI與政府數位服務機構GDS)嘗試提供政策建議與審查機制。

國際訪談反映的關鍵觀點

文章透過訪談英國、德國、荷蘭等13國共16位監獄與數位治理專家,研究團隊歸納出幾項實務觀察:

1. AI技術在監所應用尚未普及,多數受訪國表示「尚未使用」,即便有應用也多屬試驗性質。

2. 對AI預測模型的信任不足,普遍對技術黑箱與決策透明度存疑。

3. 多國認為應先強化基本數位治理能力,並建構跨部門合作的倫理審查機制。

圖1:監獄中的人工智慧探討研析

圖片來源:本研究整理

結語

AI在監獄場域的應用充滿潛力,特別是在提升管理效率與危機預警方面。然而,技術的發展不能脫離倫理與制度規範。未來的關鍵在於:如何確保AI應用「技術可信、過程透明、權責明確」,並透過跨國對話建立更完整的治理框架,以實現真正以人為本的智慧監獄系統。

封面圖片來源:本文作者以AI生成

參考資料來源:

Pia Puolakka、Steven Van De Steene(2021). Artificial Intelligence in Prisons in 2030: an exploration on the future of AI in prisons

黃盈婷、方嘉伶

2025-08-22