2026 CES 後的運算新秩序——NVIDIA 與 AMD 的技術路徑分歧與未來展望

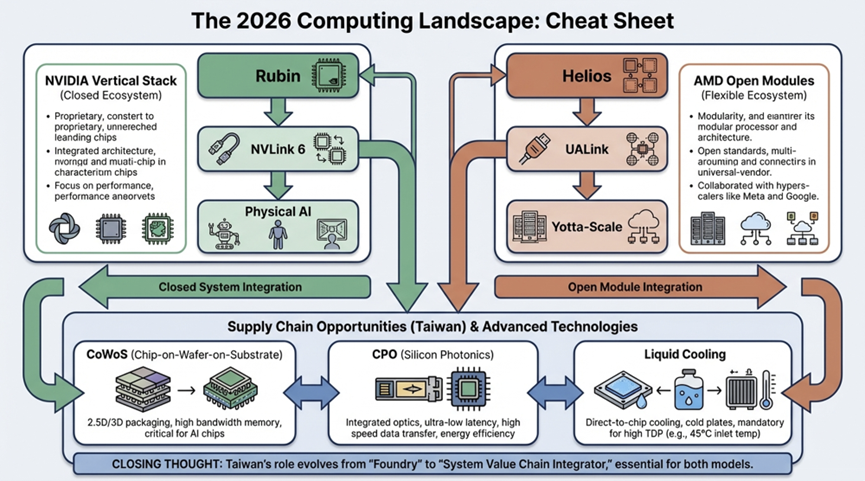

2026 年的 CES(消費電子展)標誌著 AI 產業發展的一個重要分水嶺。過去幾年單純追求「單晶片算力(FLOPS)」的競賽已成過去式。從今年的發布內容來看,NVIDIA 與 AMD 不再僅僅是晶片設計商,而是演化為兩種截然不同的「運算體系」架構者。

NVIDIA 走向了極致的垂直整合(Vertical Integration),試圖將物理世界數位化;而 AMD 則選擇了橫向擴展(Horizontal Scaling)與開放生態,致力於算力的普及化與巨量化。以下從技術架構、戰略重心及市場影響三個面向進行深度剖析。

NVIDIA:打造「物理 AI」的封閉式帝國

NVIDIA執行長黃仁勳在CES 2026的演講核心不再只是生成文字或圖片,而是「Physical AI(實體AI)」——即讓 AI 理解並模擬真實世界的物理定律。

1. 技術架構演進:Rubin 平台與全端優化

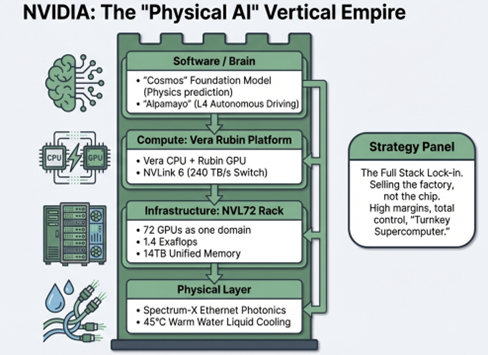

NVIDIA 推出了繼 Blackwell 之後的全新架構 「Vera Rubin」,代號 Vera Rubin六晶片次世代 AI 計算平台不僅是晶片的升級,更是資料中心架構的重塑。Rubin 平台包括新款 Rubin GPU、名為 Vera 的資料中心 CPU、最新 NVLink 6 GPU直連匯流排、Spectrum-X 光乙太網交換技術、ConnectX-9 400G網卡及 BlueField-4 DPU 等,將計算、網路、儲存緊密耦合。

NVIDIA執行長黃仁勳強調,這種從處理器、加速器到網路設備的極致協同設計(co-design)能消除系統瓶頸,使 AI 推理成本銳減至前代平台的十分之一。NVIDIA 掌控整個硬體與軟體堆疊,提供猶如完整超級電腦的交鑰匙解決方案,針對雲端巨擘的「AI 工廠」需求而生。例如 Rubin NVL72 機架系統由 72 顆 GPU 組成單一邏輯運算域,具備 1.4 exaflops AI 算力與 14 TB 記憶體,透過 NVLink 6 打造高速內部網絡。這種封閉而深度優化的平台,被喻為 AI 時代的「高牆花園」,用無縫體驗和極致性能將客戶牢牢留在 NVIDIA 生態圈內。

圖1. NVIDIA Rubin NVL72系統由72顆GPU組成具1.4 exaflops AI 算力搭配NVLink 6高速內部網絡深度優化,喻為AI時代的「高牆花園」

圖片來源:AI生成

NVIDIA Rubin 平台透過 NVLink 6 打破 CPU-GPU 界線,並結合矽光子與高溫液冷技術,重塑高效能運算架構與資料中心能源邏輯,技術簡述如下:

- Vera CPU & Rubin GPU: 透過專有的 NVLink 6 Switch(頻寬達 240 TB/s),NVIDIA將CPU與GPU的界線模糊化,實現了記憶體的完全統一。

- 100% 液冷與光互連:為了突破摩爾定律的物理極限,Rubin 平台引入了Spectrum-X Ethernet Photonics(矽光子技術),直接將雷射光源整合進晶片,並採用進水溫度 45°C 的溫水冷卻設計,徹底改變了資料中心的能源管理邏輯。

2. NVIDIA戰略重心:Cosmos 模型與數位孿生

- NVIDIA 的護城河正從硬體轉向「數據定義的物理世界」。

- Cosmos 基礎模型: 這是一個訓練用來「預測物理反應」的模型,而非語言模型。它能生成符合物理定律的影片與數據,為機器人(Robotics)和自動駕駛提供訓練場域。

- Alpamayo 自駕平台: 開源 L4 級自駕技術,意在讓所有車廠都依賴 NVIDIA 的模擬與訓練生態,將實體世界的數據霸權握在手中。

3. NVIDIA發展之產業啟示

NVIDIA 正在將自己變成一家「基礎設施公司」。值得注意的是,為了擴大生態影響力,NVIDIA 也開始在軟體層採取部分開放姿態。例如公布多領域的開放 AI 模型,涵蓋醫療(Clara)、氣候(Earth-2)、機器人(Cosmos)等,開放給開發者使用。

NVIDIA執行長黃仁勳宣稱這些模型「對全世界開放」,希望透過開源模型內容吸引更多開發者採用 NVIDIA 平台。然而,底層模型雖開放,訓練與部署仍高度依賴 NVIDIA 硬體,這被分析人士解讀為 NVIDIA 的雙軌策略:一方面築起封閉硬體和軟體高牆,一方面釋出「開放」模型餌誘,確保開發者最終還是回到自家 GPU 基礎設施上運行未來的客戶不僅買它的晶片,更必須買它的機櫃、散熱方案、網路交換器甚至軟體模型。這種「全端(Full Stack)鎖定」策略將帶來極高的利潤,但也可能引發巨頭客戶(如 Amazon, Google)更強烈的自研晶片動機。

AMD:擁抱「Yotta 級運算」的開放聯軍

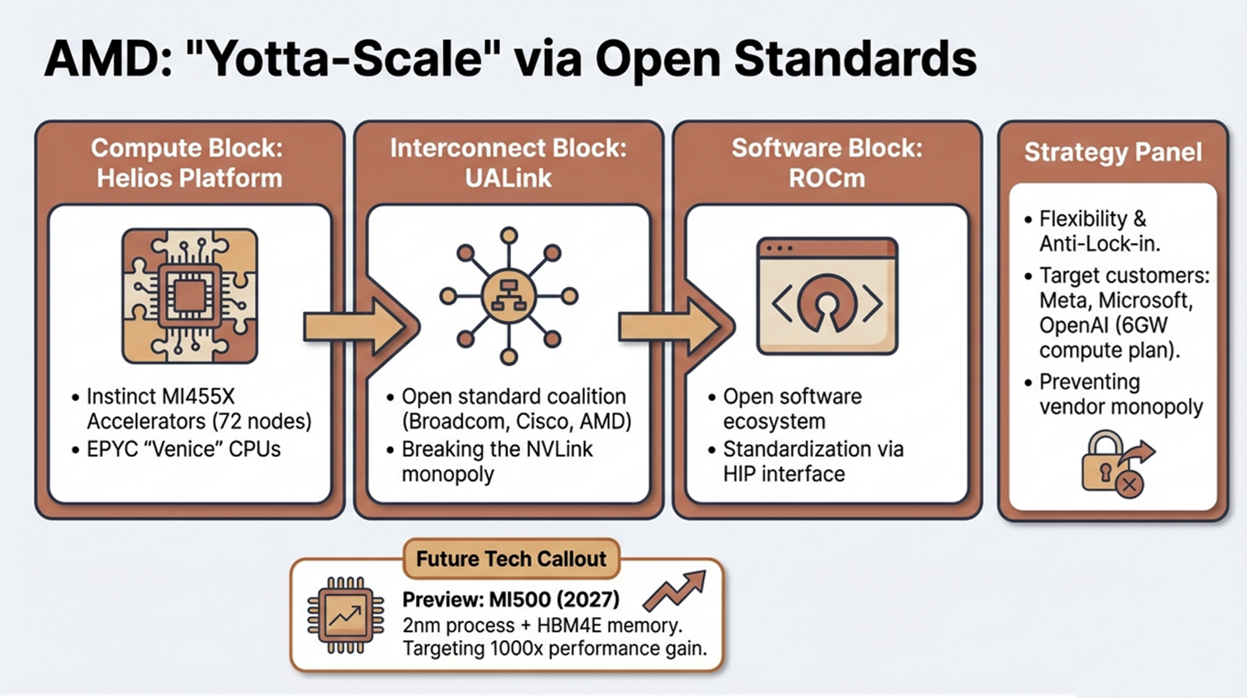

相較於NVIDIA的封閉與統治,AMD執行長蘇姿丰在 CES 2026提出的口號是「Yotta-Scale Computing」,強調與合作夥伴共同打破算力天花板。

1. 技術架構演進:Helios 平台與小晶片優勢

AMD 充分利用了其在 Chiplet(小晶片)技術上的領先地位,推出了 Helios 機櫃級平台,呈現出截然不同的生態系發展觀。AMD執行長蘇姿丰發表了代號 Helios 的機架級 AI 基礎架構藍圖,號稱為邁向「Yotta級」算力時代提供範本。Helios 採取開放、模組化設計哲學:整個機架由多節點組成,可隨產品世代快速演進,而不是封閉的一體機。其首波配置包含 Instinct MI455X 加速器(72 顆)和 EPYC “Venice” 伺服器處理器,搭配 Pensando “Vulcano” 高速網卡進行橫向擴充。Helios 最大亮點在於完全基於開放軟體生態運行,所有組件統一在 ROCm 平台下協作。這意味開發者可使用標準化的 HIP 程式設計介面跨裝置部署 AI 工作負載,不受限於特定廠商專有工具。

圖2. AMD Helios 最大亮點在於完全基於開放軟體生態運行,所有組件統一在 ROCm 平台下協作

圖片來源:AI生成

AMD 以 MI455X 推升單機櫃算力至 3 Exaflops,並預告 MI500 將結合 2nm 製程與 HBM4E 記憶體,展現其在高密度封裝與大型語言模型訓練市場的強攻企圖,技術特點簡述如下:

MI455X加速器與 Venice CPU: 透過先進封裝將運算密度推向極致,單一機櫃即可提供3 Exaflops的AI算力。

MI500系列前瞻(2027): 預告採用台積電 2nm 製程與 HBM4E記憶體,宣稱效能將是 MI300X的1000倍。這顯示 AMD 試圖透過更激進的製程採用與記憶體容量優勢(比 NVIDIA 高出 50%)來爭取大型語言模型(LLM)訓練的市佔。

AMD戰略重心:開放生態與邊緣運算

AMD執行長蘇姿丰強調,建構下一階段 AI計算版圖需要開放平台與深度協同創新,AMD 將透過端到端產品組合與產業夥伴合作,推動「AI 無所不在,人人可及」的願景。這種策略本質上是與 NVIDIA 封閉體系的對位:避免供應商鎖定(vendor lock-in),提供雲服務商和大型用戶更多元的選擇。例如,雲端客戶未來可依自身需求混搭不同廠牌 CPU、GPU 或加速器,再透過 ROCm 統一管理,使架構具備組合彈性。在 AMD 看來,這條「開放高速公路」將吸引對 NVIDIA 專有架構心存疑慮的客戶,形成與N家分庭抗禮的生態體系。

- UALink 與開放標準: AMD聯合Broadcom、Cisco等廠商推動 UALink(Ultra Accelerator Link),試圖建立非NVIDIA 陣營的互連標準,打破 NVLink 的壟斷。

- AI PC 與邊緣滲透:推出的 Ryzen AI 400 與 Ryzen AI Max+ 系列,主打在筆電與迷你PC上就能運行千億參數級模型。這是 AMD 的差異化打法——在雲端追趕的同時,搶先佔領「地端推理(On-Device Inference)」的龐大市場。

AMD發展之產業啟示

在 CES 展場上,AMD 也展示了 Helios 的早期原型及完整 Instinct MI400 系列產品線,預告下一代 MI500 GPU 將於 2027 年問世,性能較 2023 年推出的 MI300X 提升達 1000 倍。雖然 1000× 的提升引發部分質疑,但從中可見 AMD 對持續技術演進的積極路線圖。總體而言,CES 2026 清晰地傳達了兩家公司截然不同的生態戰略:NVIDIA 將AI算力做成封裝完備的黑盒子出售,而 AMD 則提供一個開放拼裝的工具箱,各自瞄準了市場中不同的受眾與需求。

AMD 的策略是「性價比與彈性」。對於不想被 NVIDIA 全家桶綁架的客戶(如 Microsoft, Meta, OpenAI),AMD 提供了唯一的替代方案。特別是與 OpenAI 的深度合作(計畫部署6GW算力),證明了AMD在超大規模訓練上已具備實戰能力。

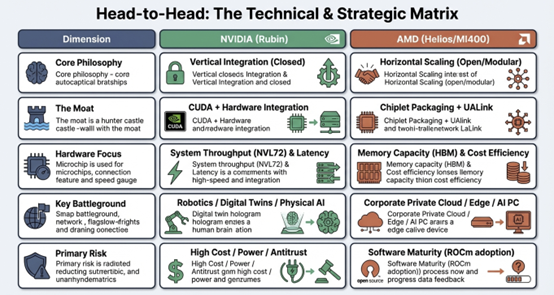

雙雄對決:2026 年後的關鍵戰場分析

2026 年後,AI 晶片產業正式邁入雙軌競爭新階段,NVIDIA 與 AMD 兩大陣營分別以「封閉整合」與「開放聯盟」為核心戰略,形塑出截然不同的生態藍圖。NVIDIA 透過 Vera Rubin 平台強化從硬體到軟體的垂直整合,聚焦於實體自動化與基礎設施主導;而 AMD 則以 Instinct MI 系列與 ROCm 平台為基礎,結合開放標準與高性價比訴求,加速滲透邊緣與私有雲市場。以下對照表即總結兩者在戰略重心、技術焦點與市場布局上的關鍵差異。

表1. NVIDIA 與 AMD 市場戰略生態藍圖比較

比較維度 | NVIDIA | AMD |

核心戰略 | Physical AI (物理 AI):從數位走向實體自動化 | Yotta-Scale (Yotta 級運算):極致的算力堆疊與開放互連 |

護城河 | CUDA + 全端硬體(機櫃/網路/散熱)垂直整合 | Chiplet 先進封裝 + 開放生態系 (ROCm + UALink) |

硬體焦點 | 系統級設計 (NVL72),強調整體吞吐量與延遲 | 記憶體容量 (HBM) 與單晶片性價比 |

新興戰場 | 機器人、數位孿生、主權 AI | AI PC、邊緣運算、企業私有雲 |

隱憂 | 成本過高、能耗巨大、反壟斷風險 | 軟體生態 (ROCm) 仍需時間追趕 CUDA |

資料來源: CES Watch: Nvidia’s Integration vs. AMD’s Open Efficiency

圖3. NVIDIA 與 AMD 市場戰略生態藍圖比較

資料來源: 由彙整表1 AI生成圖形

結論:AI 產業的「雙軌制」成形

2026 年後的 AI 晶片市場將不再是「贏者全拿」的局面,而是分化為兩條平行軌道:

頂級訓練與物理模擬(NVIDIA 主場): 凡是涉及最尖端基礎模型訓練、藥物研發、人形機器人模擬等需要極致頻寬與低延遲的場景,NVIDIA 的 Rubin 平台仍將是唯一解。

大規模推理與高性價比訓練(AMD 機會): 隨著AI應用進入「推論期」,企業需要更具成本效益的方案。AMD憑藉大記憶體優勢與開放標準,將在資料中心推理、AI PC及特定垂直領域(如監控、工業檢測)獲得大量市佔。

給投資人與決策者的建議: 未來觀察重點不應只看「誰的晶片快」,而應關注「能耗比(Performance per Watt)」與「生態系閉環」。NVIDIA 正在挑戰物理極限,試圖用矽光子與液冷重寫資料中心規則;而 AMD 則在賭一個「非 NVIDIA 壟斷」的開放未來。這場戰爭,才正要進入最精彩的下半場。

FIND觀點

2026年CES展所揭示的「雙雄對決」,對台灣而言,不再僅是晶片訂單的爭奪戰,而是一場「系統級價值鏈(System-Level Value Chain)」的重分配。隨著 NVIDIA 走向封閉式的全端系統、AMD擁抱開放標準,台灣供應鏈將被迫(也同時受惠)進行更細緻的分工與升級。

圖4. 「NVIDIA 與 AMD 雙雄對決」對台灣而言是一場「系統級價值鏈(System-Level Value Chain)」重新分配

資料來源: 本文作者研究整理

一、代工角色的典範轉移:從「晶片製造」到「封裝即系統」

過去台灣的護城河在於台積電的先進製程(2nm/3nm)。然而,隨著NVIDIA Vera Rubin與AMD Helios平台的推出,競爭焦點已轉移至先進封裝(Advanced Packaging)。

CoWoS與SoIC 的戰略地位: NVIDIA的Rubin GPU與CPU融合,以及AMD對Chiplet的極致應用,都極度依賴台積電的CoWoS與SoIC技術。台灣半導體產業必須加速擴充「後段封裝」產能,這將帶動本土封測設備商(如弘塑、萬潤)與載板廠(如欣興)的技術紅利。

矽光子(CPO)的量產元年: NVIDIA引入Spectrum-X Ethernet Photonics,意味著訊號傳輸已由「電」轉「光」。台灣的光通訊產業(如波若威、眾達)將迎來歷史性機遇,需從傳統的光收發模組轉向與晶片廠共同開發 CPO(共同封裝光學)元件,這將是未來三年的最大成長動能。

二、 伺服器ODM的兩極化:系統整合vs.模組化彈性

台灣的伺服器代工廠(鴻海、廣達、緯穎、技嘉)將因應兩大陣營的策略而走向兩極化發展:

NVIDIA 陣營的「精密製造」: 由於 NVIDIA 銷售的是 NVL72這種「機櫃即電腦」的方案,系統設計高度標準化且複雜。台灣ODM 廠的角色將從設計代工轉向**「極致組裝與測試」**。這要求廠商具備極高的良率控制與液冷組裝能力,進入門檻變高,大者恆大的趨勢將更明顯。

AMD 陣營的「客製化設計」: AMD 推動 UALink 與開放模組,給予了台灣 ODM 廠更多發揮「設計實力」的空間。針對不同企業客戶(如 Meta 或 Microsoft)的特殊需求,台灣廠商可以利用AMD 的開放架構設計差異化的伺服器,這將是中型 ODM 廠或主打利基市場者的生存之道。

三、「物理 AI」帶動的第二波浪潮:IPC 與散熱產業的黃金期

NVIDIA執行長黃仁勳強調的 Physical AI(實體 AI)與機器人產業,將是台灣工業電腦(IPC)與機電產業的下一座金礦。

液冷散熱成為標配: 隨著資料中心進水溫度提升至 45°C,傳統氣冷宣告死亡。台灣散熱雙雄(雙鴻、奇鋐)在液冷板(Cold Plate)與冷卻液分配單元(CDU)的佈局將直接決定其在 AI 供應鏈的地位。台灣極有機會成為全球「AI 散熱方案」的制定者。

機器人供應鏈的整合: Physical AI 需要軀體。台灣精密機械與馬達控制(如上銀、台達電)擁有世界級實力。當 AI 大腦(NVIDIA Cosmos)成熟,台灣將順勢成為 AI 機器人的軀幹製造基地,從伺服器機房走向工廠與家庭。

封面圖片來源:本文作者以AI生成

參考資料來源:

1.Highlights From AMD's CES 2026 Keynote: Everything That Happened in 14 Minutes

https://www.youtube.com/watch?v=ZAKTc4FwqR8&t=177s

2.NVIDIA 官方博客,《NVIDIA Rubin Platform, Open Models, Autonomous Driving: NVIDIA Presents Blueprint for the Future at CES》

3.AMD 新聞稿,《AMD and its Partners Share their Vision for “AI Everywhere, for Everyone” at CES 2026》

4.TechSoda 分析,《CES Watch: Nvidia’s Integration vs. AMD’s Open Efficiency》

5.Network World 報導,《Arm backs both sides in UALink vs NVLink battle for bandwidth》

6.Data Center Knowledge 專欄,《CES 2026: AMD Targets Data Center with Instinct GPU Additions》

7.Introl 技術博客,《AMD Helios Challenges NVIDIA: The MI455X and the Battle for AI Infrastructure Supremacy》

8.ABI Research 深度觀察,《UALink versus NVLink — Open versus Closed: Chipping Away at NVIDIA’s Proprietary Wall》

9.Deriv 投資觀點,《AMD vs Nvidia at CES 2026: Two different AI chip moves》

10.Seeking Alpha 投資文章,《I'm Raising My AMD Conviction Into CES 2026 - Here's What Would Prove Me Right》

11.TechSoda 分析,《CES Watch: Nvidia’s Integration vs. AMD’s Open Efficiency》

黎毅輝

2026-02-04