解除 AI 封印!OpenClaw 爆紅背後的真相:它是個人化執行的終極利器,還是實驗性的安全冒險?

OpenClaw(原 Clawdbot)開源專案在2026年1月迅速在GitHub上爆紅,短時間內就讓全球無數的工程師趨之若鶩。OpenClaw已經在GitHub上獲得超過6萬顆星,在 2026 年 1 月應 Anthropic(Claude 模型開發商)要求,正式更名為 Moltbot(2026年1月底正式更名為OpenClaw)。 Moltbot 是一個可以串接各種大型語言模型(LLM)的AI代理程式,OpenClaw的優勢在於它讓AI從被動的對話框升級成主動的AI代理人,這表示用戶只要透過社群軟體(如 :iMessage, WhatsApp等)下達指令就可以操作本地電腦直接執行任務。

OpenClaw的強大在於可以操作所有在本地電腦內的所有資料與程式,也因此,OpenClaw在安全與隱私的部分存在爭議。雖然OpenClaw強調是將資料儲存在本地電腦,但是實際還是使用外部的大型語言模型與大量的API,而API金鑰的洩漏風險此時就凸顯出來了。所以開發者史坦伯格也在GitHub的常見問題中說明,OpenClaw目前是一個實驗性質的工具,不存在絕對安全的設定。這意味著當使用者不了風險時請不要隨意地嘗試使用OpenClaw。

OpenClaw目前處於實驗性質,使用時應全面洞悉風險性

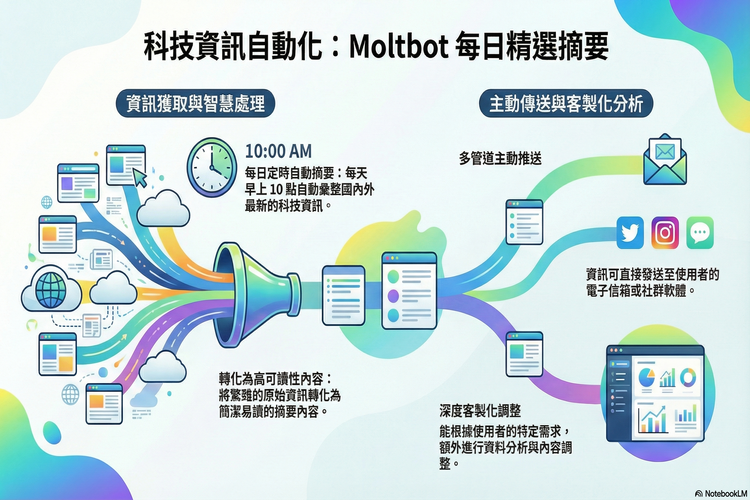

OpenClaw可以用來做什麼呢?其實OpenClaw可以說是個人化的Google Gemini或 Anthropic Claude,例如:你可以讓GPT或Gemini每天早上10點提供一份目前國內外最新的科技資訊並且轉換成一份可讀的摘要內容,同時OpenClaw可主動傳送到你的信箱或是社群軟體上,還可以再根據需求額外進行分析與調整,如下圖所示。換言之,OpenClaw最大的革命是在於「執行」,不僅止於提供建議,而是實際生成程式碼執行你的特定需求。

圖1:運用Moltbot(2026年1月底正式更名為OpenClaw)每日生成資訊摘要示意圖

圖片來源: 本文作者以AI生成

因此,往後幾年的生活與工作的模式會將逐漸從「AI協作」轉變成「AI代理」,人人都可以透過AI解決原先可能不擅長的事情,讓人們可以更專注在「思考」與「決策」,進一步快速累積不同的經驗。不過,在我們從AI的操作者轉變成AI的管理者的同時,其所需要具備的專業知識及對於AI的安全與隱私就需要有更全面的認識。

封面圖片來源: 本文作者以AI生成

參考資料來源:

1.Socradar官網: socradar.io

2.Inside官網: inside.com.tw

3.科技新報官網: technews.tw

4. GitHub開源網站: github.com

楊長恩

2026-02-12