AI餵養時代來臨!找出決定「信任」AI應用成敗的兩大關鍵

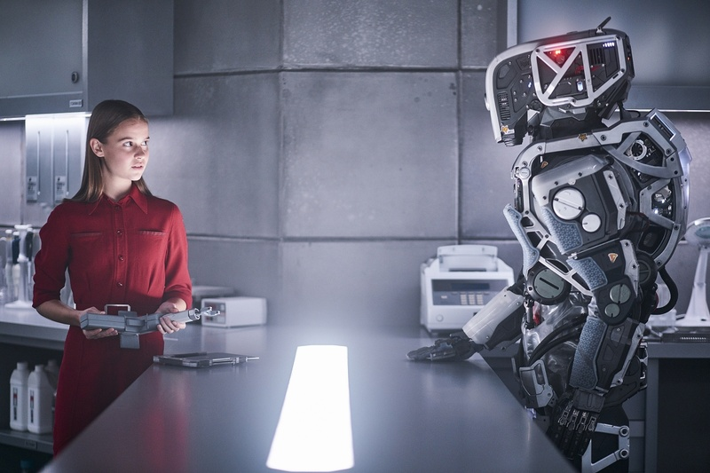

2019年由兩屆奧斯卡、金球獎影后希拉蕊史旺(Hilary Swank)主演的「AI終結戰」(I Am Mother)電影,講述一位被AI機器人撫養長大的小女孩的故事,導演格蘭特·斯普托爾(Grant Sputore)以假設性的未來情境,探討人類與AI機器人關係及倫理道德之間的議題。

【被AI餵養的時代來臨】

在近十年AI科技高速發展的時代,人類與AI科技的親密關係已逐步改變我們的生活、工作、創作與決策模式,受到大大量AI資訊餵養下,各種AI辨識、生成、學習、互動、判斷、決策…等應用服務,科幻小說與電影所描述的情境已發生在我們生活中,但AI幻覺、濫用、侵權…等議題,衍生出AI資訊餵養的倫理困境與信任關鍵議題。我們正處於一個由全球數據「餵養」的高度自主AI時代,如何確保這些AI應用服務不會在追求效率的同時犧牲了人類的價值觀?這場信任危機驅使我們必須思考AI治理的兩大關鍵:負責任AI(Responsible Artificial Intelligence,RAI)與可信賴AI(Trustworthy AI,TAI),思考AI應用能否獲得符合倫理、法規、公眾信任、避免失敗等議題。

【負責任AI】

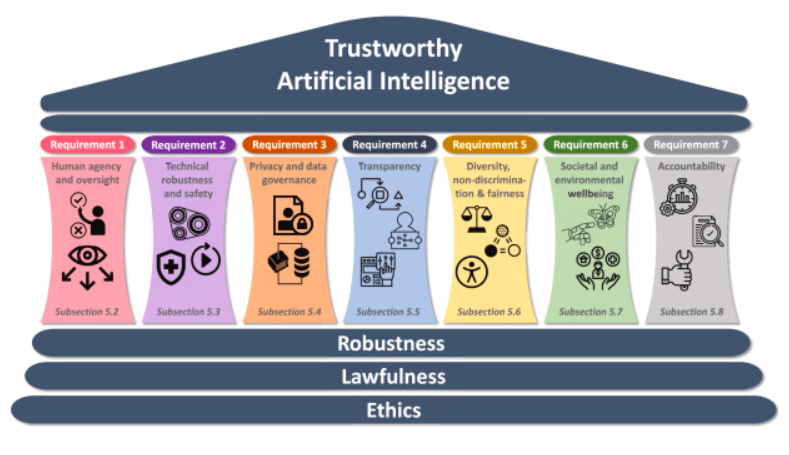

為了建立AI的原理原則基礎,歐盟委員會(European Commission)在2019年由人工智慧高層專家組(High-Level Expert Group,HLEG)發布的七項負責任AI的關鍵要求:問責制(Accountability)、多樣性、非歧視與公平性(Diversity, Non-discrimination, and Fairness)、人類能動性與監督(Human Agency and Oversight)、隱私與數據治理(Privacy and Data Governance)、技術穩健性與安全(Technical Robustness and Safety)、透明度(Transparency),以及社會與環境福祉(Social and Environmental Well-Being),之後包括微軟、Amazon、PWC等各家國際大廠均提出他們設計與提供AI服務的負責任AI原則。

我們可以說負責任AI代表一套原則,強調的是人類行為與流程,是一種以人為中心的治理架構,是一種AI設計和部署提供「指引」與「目標」,用來確保AI技術或系統在整個生命週期中都符合使用者期望、企業價值觀、社會法律和慣例,並具備倫理、透明和問責的特性,且總體而言是人類認為的「好的」。

圖1:歐盟委員會的人工智慧高層專家組七項負責任AI關鍵要求

資料來源:https://montrealethics.ai/connecting-the-dots-in-trustworthy-artificial-intelligence-from-ai-principles-ethics-and-key-requirements-to-responsible-ai-systems-and-regulation/

【可信任AI】

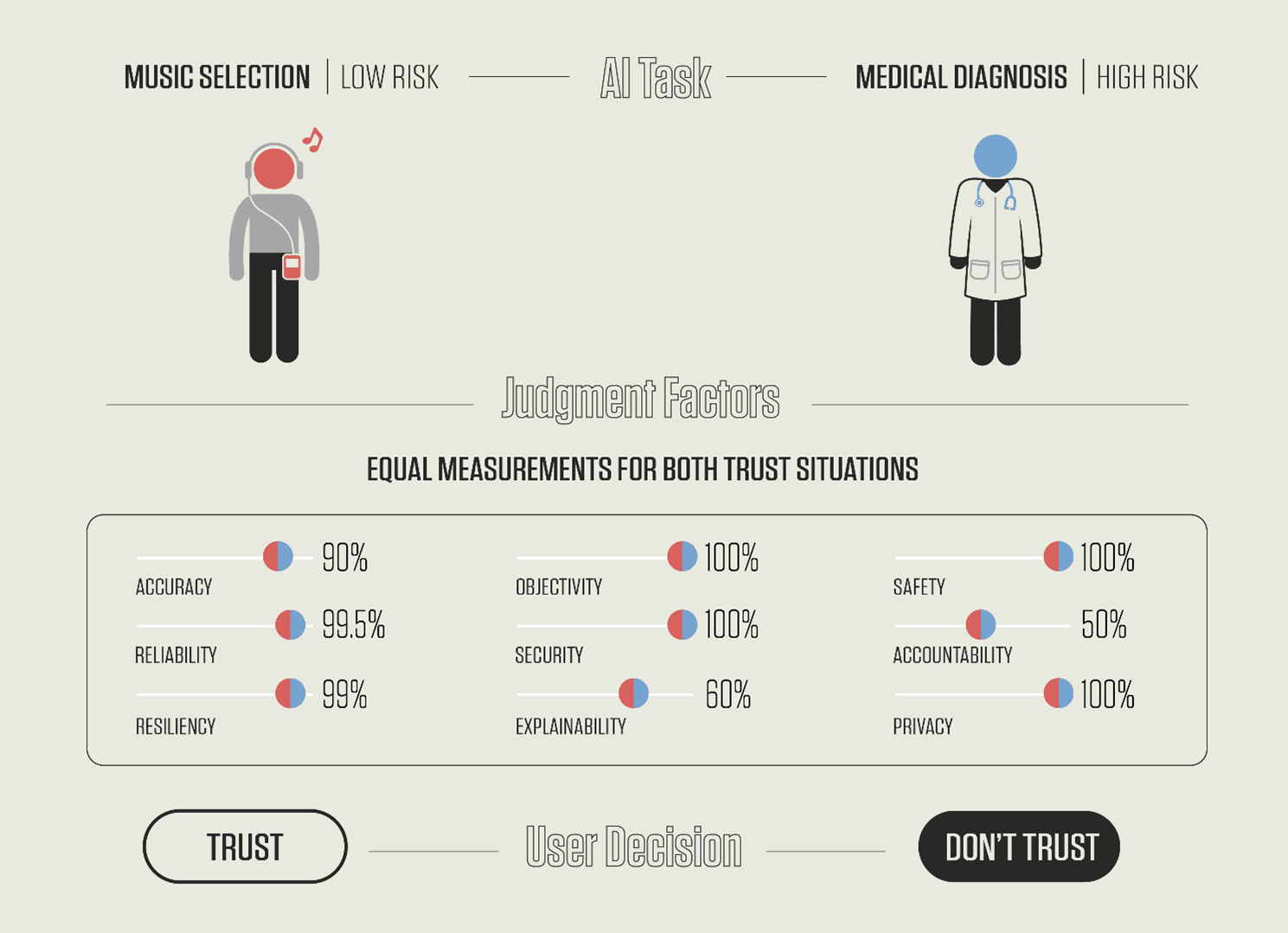

而可信任AI則是回歸數位系統本身,強調以系統技術、演算法、推論模型與品質實現並達到人類的信任,讓AI系統在不同場景與使用過程中表現一致、可靠、可預測,相關因素我們可以參考美國國家標準與技術研究院(National Institute of Standards and Technology,NIST)在2021年提出人工智慧風險管理框架(AI RMF 1.0),其中包括影響人類對AI系統所提出的九個可信任AI特徵:準確性(Accuracy)、可靠性(Reliability)、韌性(Resiliency)、客觀(Objectivity)、安全防護(Security)、可解釋性(Explainability)、安全狀態(Safety)、問責制(Accountability)及隱私性(Privacy),各家業者上也都因應此特徵因素建立各自的AI系統服務指標。

圖2:美國國家標準與技術研究院提出九項可信任AI特徵

資料來源:https://nvlpubs.nist.gov/nistpubs/ai/nist.ai.100-1.pdf

【AI信任衡量指標】

信任是歷史上人類社會的主要基礎之一,那麼AI信任可以量化和衡量嗎?NIST以大家習以為常的智慧型手機AI音樂推薦App,以及AI癌症輔助診斷系統來舉例,人們對這九個因素的重視程度,可能因任務本身以及信任人工智慧決策所涉及的風險而有所不同,雖然技術面在這九個可信任AI的衡量得分可能接近相同。然而,使用者可能更傾向於相信音樂推薦App,而不是相信執行風險更高的醫療輔助任務的醫療輔助系統。

圖3:美國國家標準與技術研究院提出可信任AI系統的特徵應用案例

資料來源:https://www.nist.gov/news-events/news/2021/05/nist-proposes-method-evaluating-user-trust-artificial-intelligence-systems

對於AI系統而言,歌曲推薦演算法與癌症診斷判斷演算法都是技術,但截然不同的情境與目的,人類可能更傾向於相信歌曲推薦演算法,而不是醫療輔助演算法,關鍵已經不單單是對AI系統品質、技術與穩定度衡量議題,而是決策所帶來的高風險或是低風險議題。NIST的布萊恩·斯坦頓(Brian Stanton)就提出「我們對信任的判斷會受到很多因素的影響,應該包括對系統的看法和感受,以及使用者對AI系統所涉及的風險的認知」,問題應該是在於人類對AI的信任是否可以衡量,如果可以,要如何準確、適當地衡量它。在實務面仍需要由更多的研究人員與應用服務業者,以兼具負責任AI的關鍵要求及可信任AI特徵的衡量指標。

因此,本文試圖綜整各項研究報告提出對照表,讓大家更好瞭解負責任AI與可信任AI:

表1:負責任AI與可信任AI比較表

特性 | 負責任AI(Responsible Artificial Intelligence,RAI) | 可信任AI(Trustworthy AI,TAI) |

核心定義 | 治理架構與流程:一套組織原則、政策、與指導方針,確保AI系統在整個生命週期中,以合乎人類的道德、法律與社會責任的方式被開發和使用 | 技術屬性與品質:AI系統本身必須具備的一組技術特徵,使其在預期運作場景中能夠穩定、安全、可靠地提供服務 |

側重焦點 | 人類行為與流程(Human Intent & Process):強調誰負責以及如何滿足治理要求 | 系統的產出與品質(System Output & Quality):強調系統本身的功能、技術、品質 |

最終目標 | 確立問責制與倫理規範:確保AI系統的應用服務符合人類價值觀,並由人類負起最終責任 | 確立系統可被使用者信任:透過系統技術品質保證,確保系統是可靠、透明且穩定的 |

關鍵要求/特徵 |

|

|

實作方式 | 成立企業AI倫理委員會、發布AI治理政策規範、提出數據合規審計、建立社會影響評估…等 | 研發偏見檢測工具、研發模型可解釋性技術、測試對抗性攻擊、研發模型衰減(Model Decay)監控技術…等 |

資料來源:本文綜整資料製作

【FIND觀點】

「信任,是最危險的付出」,電影的情節如同一面鏡子映出我們面對AI快速發展的憂心,當新世代的數位原民(Digital Native)如同電影中被AI餵養長大,對AI具備高度的信任,未來必然面對是否要將其決策權託付給AI的現實難題,在我們高速發展AI數位科技的同時,是否更應認真思考負責任AI與可信任AI的衡量指標建立與實踐,在AI應用發展中兼具發揮最大化價值與避免風險與意料之外的後果。

封面圖片來源:開眼電影網網站 https://app2.atmovies.com.tw/eweekly/XE1906263391/

參考資料來源:

- https://ithelp.ithome.com.tw/articles/10270241

- https://ictjournal.itri.org.tw/xcdoc/cont?xsmsid=0M208578644085020215&sid=0M348549487608256517

- https://app2.atmovies.com.tw/eweekly/XE1906263391/

- https://vocus.cc/article/5d0f9b4bfd89780001a4de8b

- https://www.epochtimes.com/b5/19/5/21/n11270259.htm

- https://www.sciencedirect.com/science/article/pii/S0963868724000672

- https://nvlpubs.nist.gov/nistpubs/ai/nist.ai.100-1.pdf

- https://nvlpubs.nist.gov/nistpubs/ir/2021/NIST.IR.8332-draft.pdf

- https://www.nist.gov/news-events/news/2021/05/nist-proposes-method-evaluating-user-trust-artificial-intelligence-systems

- https://ec.europa.eu/newsroom/dae/document.cfm?doc_id=68342

- https://montrealethics.ai/connecting-the-dots-in-trustworthy-artificial-intelligence-from-ai-principles-ethics-and-key-requirements-to-responsible-ai-systems-and-regulation/

- https://support.microsoft.com/zh-tw/topic/%E4%BB%80%E9%BA%BC%E6%98%AF%E8%B2%A0%E8%B2%AC%E4%BB%BB%E7%9A%84-ai-33fc14be-15ea-4c2c-903b-aa493f5b8d92

- https://aws.amazon.com/tw/ai/responsible-ai/

- https://www.pwc.tw/zh/publications/global-insights/responsible-ai-insights.html

徐福祥

2025-12-01