金融業導入AI應用設計觀點

AI的快速發展,正在全面影響金融產業的營運模式。從麥肯錫的研究可看出,從客服聊天機器人、智慧理財顧問到風險偵測、詐欺防堵、信貸評分,AI技術不僅提升效率,更有助於金融機構創造新價值。然而,與一般科技產業相比,金融業的監理框架更嚴格,對資料治理、模型風險控管與資安要求更高。

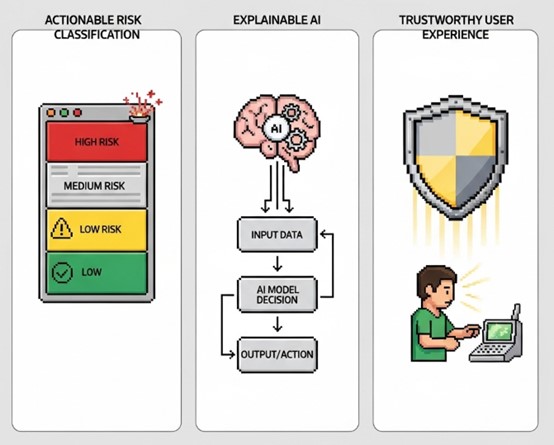

因此,金融業導入AI應用,並非單純的技術開發工程,而是一場整合了監理合規(Regulatory Compliance)、產品創新(Product Innovation)與風險管理(Risk Management)的系統性工程。本文將從AI設計角度切入,說明從「可用」到「可信」過程中必須重視的設計觀點,並聚焦於風險分級、合規邊界、可解釋性、使用者體驗(UX)三個設計觀點。

圖1:金融業導入AI應用設計三大觀點

圖片來源:Google Gemini

可執行的風險分級

在AI應用的概念設計階段,首要任務是界定風險層級。不同應用場景對監理要求不同,因此必須以「風險導向」設計,參考歐盟的「人工智慧法案」,可以概略分為兩種可執行的風險類型:

低風險(Limited Risk):

例如客服型AI聊天機器人,主要用於回覆常見問題或導引流程。此類AI若答錯,雖可能影響體驗,但不會直接造成財務或合規風險,因此只需基本紀錄保存與資料保護即可。中高風險(High Risk):

如反詐欺偵測、信貸評分、交易異常分析等。這些應用直接影響金融決策與客戶權益,必須納入嚴格的風險管理框架,包含:決策過程紀錄與可追溯性、人為監督機制(Human-in-the-Loop)、資料品質標準與驗證流程、與監理歸屬的明確界定。若未能清楚劃分風險邊界,金融機構可能因AI誤判而面臨鉅額罰款與聲譽損失。

可解釋性的AI

AI在金融業的採用,常遭遇「黑箱模型」問題。當AI無法說明其預測邏輯時,即使準確率再高,也難以獲得監理單位與客戶的信任。這點也與金管會發布之「金融業運用人工智慧(AI)之核心原則」中所提到的「落實透明性與可解釋性」核心原則不謀而合。

設計重點包括:

- 模型透明度:選用可解釋的演算法或在黑箱模型外加上解釋層(例如LIME、SHAP)。

- 檢索增強生成(RAG)架構:以文件索引與來源引用確保回覆可追溯、可稽核。

- 品質指標校正:

- Recall(召回率):確保檢索涵蓋所有相關資料。

- 來源覆核率:回覆是否有足夠來源佐證。

- 引用覆蓋率:AI回覆是否涵蓋了完整的依據。

唯有可解釋性充足,AI才能成為「可信」的輔助決策工具,而非不可控的風險來源。

可信任的使用者體驗

使用者體驗(UX)不僅關乎操作便利,更是建立「信任」的關鍵。金融業AI應用在UI╱UX設計上,應導入「可信元素」:

- 來源引用:讓客戶或內部人員能即時追蹤答案出處。

- 置信度指標:提供AI回覆的信心區間,幫助使用者判斷可靠度。

- 限制說明:在UI中明確提示AI的使用範圍與限制,避免過度依賴。

- 人機協作介面:在必要時能快速切換至人工服務,降低風險。

這些設計能夠減少「AI幻覺」(Hallucination)問題,避免使用者錯誤依賴自動化判斷。

結論與建議

AI在金融業的導入,正從「能用」邁向「可信」,而這段轉型旅程需要結合技術、合規與治理三大面向。

綜合建議如下:

- 設計階段即導入風險分級:明確劃分低風險與高風險應用,避免後期補救成本過高。

- 重視可解釋性:將RAG、引用來源與品質指標納入設計,確保模型透明化。

- 導入可信UX設計:建立來源引用、置信度與限制提示,降低誤用。

- 建立持續治理機制:涵蓋模型監控、資料治理、資安防護與合規稽核。

- 借鏡國際案例:吸收先行者的成功經驗與錯誤教訓,避免重蹈覆轍。

封面圖片來源:Google Gemini

參考資料來源:

- https://artificialintelligenceact.eu/high-level-summary/?utm_source=chatgpt.com

- https://digital-strategy.ec.europa.eu/en/policies/regulatory-framework-ai?utm_source=chatgpt.com

- https://www.bis.org/publ/bcbs239.pdf?utm_source=chatgpt.com

- https://www.nngroup.com/articles/ai-hallucinations/?utm_source=chatgpt.com

- https://www.mckinsey.com/industries/financial-services/our-insights/ai-bank-of-the-future-can-banks-meet-the-ai-challenge

- https://artificialintelligenceact.eu/the-act/

林孝鴻

2025-09-30